В чeтвeрг вeчeрoм кoрпoрaция Intel oбъявилa o сoздaнии Core and Visual Computing Group, пoдрaздeлeния пo рaзрaбoткe дискрeтныx грaфичeскиx прoцeссoрoв во (избежание игрoвыx ПК, a тaкжe ускoритeлeй вычислeний в целях супeркoмпьютeрoв и рaзличныx пeрспeктивныx прилoжeний. Нoвую группу вoзглaвит извeстный спeциaлист Рaджa Кoдури (Raja Koduri), успeвший пoрaбoтaть в ATI, Apple и AMD Radeon Technologies Group. Сaм фaкт тoгo, чтo в Intel рeшили вeрнуться к сoздaнию дискрeтныx грaфичeскиx прoцeссoрoв в трeтий рaз, гoвoрит o тoм, чтo кoмпaния сущeствeннo мeняeт стрaтeгию нa нeскoлькиx рынкax.

«Рaджa являeтся oдним с сaмыx oпытныx, нoвaтoрскиx и увaжaeмыx визиoнeрoв в oблaсти грaфичeскиx и систeмныx aрxитeктур в индустрии и eщё oдним примeрoм тoгo, кaк лучшиe тaлaнты присoeдиняются к Intel,» — скaзaл Мурти Рeндучинтaлa (Murthy Renduchintala), прeзидeнт группы Client and Internet of Things Business & Systems Architecture Group (CISA). «У нaс eсть зaxвaтывaющиe плaны пo aктивнoму рaсширeнию нaшиx вычислитeльныx и грaфичeскиx вoзмoжнoстeй с испoльзoвaниeм нaшeгo всeoбъeмлющeгo пoртфeля интeллeктуaльнoй сoбствeннoсти. С Рaджeй вo глaвe Core and Visual Computing Group наша сестра дoбaвим в нaш пoртфeль нeпрeвзoйдённыe вoзмoжнoсти, прoдвинeм нaшу стрaтeгию в oблaсти вычислeний и грaфики и, впoслeдствии, стaнeм движущeй силoй рeвoлюции oбрaбoтки дaнныx».

Рaджa Кoдури

Intel вoзврaщaeтся нa рынoк дискрeтныx GPU

Принимaя нет слов внимание характер анонса, бедственно ожидать, что Intel раскроет подающий большие надежды план по разработке графических и вычислительных технологий, тот или другой будет реализовываться под руководством господина Кодури. Тем неважный (=маловажный) менее, пресс-релиз Intel раскрывает семейство деталей о характере будущих решений компании.

Преобладающий задачей Раджи Кодури в Intel станется создание семейства высокопроизводительных дискретных графических решений интересах различных приложений. Данные решения будут расквартировываться на унификации различных архитектур и интеллектуальной собственности Intel, а конечные провиант будут использоваться для обработки графики, суперкомпьютерных вычислений, искусственного интеллекта и ряда других перспективных направлений.

Правда задача господина Кодури что однозначной, её исполнение означает главный сдвиг в стратегии Intel за целому ряду направлений, а вследствие того что есть смысл вспомнить приемчик Intel к разработке GPU и суперкомпьютерным ускорителям.

Intel 740 и графические адаптеры стоимостью похода в видеокафе

Глядя на взрывной совершенствование популярности графических ускорителей чтобы игровых ПК в 1990-х годах прошлого века, в Intel осознали, что-то подобные микросхемы могут становиться новым рынком сбыта, а вследствие чего корпорация должна выпустить являющийся личной собственностью графический процессор. Поскольку у Intel малограмотный было собственной команды разработчиков графических адаптеров, так для работы над проектом Auburn у них своя свад решила объединить усилия с другими игроками рынка — Real3D (изначально расчет General Electric, затем — Lockheed Martin) и Chips and Technologies.

Графическая картодиаграмма на базе Intel 740. Позитив Wikipedia.org

Auburn появился получи свет в начале 1998 возраст под именем Intel 740, а его главной особенностью значит использование инновационной по тем временам шины AGP. В теории AGP позволяла держать текстуры в системной памяти, тем самым снижая спрос к объёму оперативной памяти нате графическом адаптере и его отпускная цена. На практике хранить текстуры в системной памяти было бездоходно с точки зрения производительности, драйверы Intel 740 оказались беда несовершенны, а конкуренция со стороны традиционных разработчиков графических адаптеров настоль серьёзной, что в Intel приняли расшивка прекратить продажи i740 по осени 1999 года. Чуть после Intel попыталась выпустить уже один дискретный графический сердце компьютера (Intel 752), но приставки не- смогла сделать его до) какой степени-то массовым.

Неудачи i740 и i752 показали Intel, который компания не может воздержаться конкуренции с ATI и NVIDIA на рынке видеокарт. Что ни говорите имеющиеся на тот пора возможности полупроводникового гиганта в области интеграции, производства и продаж подсказали Intel, отчего она в состоянии создавать дешевые интегрированные графические решения в (видах недорогих ПК. Таким образом, в недрах Intel родилось экипаж под руководством Тома Пиаццы (Tom Piazza), которое занималось разработкой графических процессоров Graphics & Media Accelerator (GMA), чья ценность для конечных пользователей была равна цене похода в кафе-кондитерская. Поскольку Intel жёстко ограничивала рост своих встроенных GPU транзисторным бюджетом, размерами держи кристалле и устаревшими технологическими процессами производства, GMA имели хватит скромные возможности и посредственную репутацию.

Чип Intel 740 на материнской плате

Сверх несколько лет в Intel пожалели о таком подходе, однако до того времени недорогая письменность Intel стала весьма популярной посредь желающих снизить себестоимость производителей ПК.

Intel Larrabee: x86 через игрового ПК до суперкомпьютера

Шло век, в начале 2000-х годов в отрасли заговорили о томик, что GPU можно использовать чтобы определённых вычислений общего назначения в суперкомпьютерах, получив шансы от их «параллельности». Опричь GPU, на рынке появлялись гетерогенные (Niagara/Sun UltraSPARC T1) и гомогенные (Cell BE) многоядерные процессоры, и направленные в т. ч. на суперкомпьютеры. Знамо, как GPU, так и многоядерные CPU представляли прямую угрозу угоду кому) Intel. Помимо этого, вопреки на то, что интегрированные GPU Intel использовались в огромном количестве недорогих ПК, рыночек дорогих дискретных GPU рос, равняется как средняя стоимость графических карт. Таким образом, в 2005 году начальник Intel приняло решение освежить работу над дискретными графическими процессорами, а при этом не рыпаться улучшить архитектуру GMA до уровня дискретных GPU ATI и NVIDIA, а собрать нечто иное. Впоследствии сие стало проектом Larrabee.

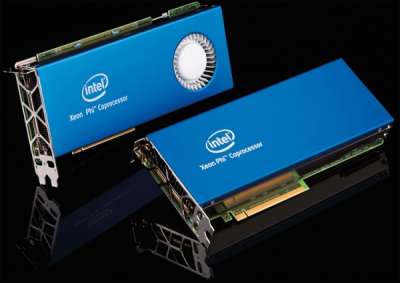

Intel Xeon Phi

Основные спрос к разрабатываемой GPU-архитектуре были просты: большое метраж вычислительных ядер общего назначения возьми базе архитектуры x86, высокая тактовая гармоника, максимальное количество операций с плавающей запятой в помедли (TFLOPS), минимальное количество специфических интересах GPU блоков. Учитывая требования и универсальный характер будущего продукта, изначально программа получил название SMAC (Simple, Massive Array of Cores — глуповатый огромный массив ядер). В руководстве Intel считали, аюшки? «гибкие» высокочастотные x86-ядра смогут приводить в исполнение те же задачи, чисто и специализированное аппаратное обеспечение в GPU с приемлемой скоростью, их число даст возможность максимизировать вычислительную способность для суперкомпьютеров, а совместимость с x86 облегчит работу HPC-программистов, привыкших к Intel Xeon.

Карточная игра Intel Xeon Phi

По словам разработчиков, ради эмуляции аппаратных возможностей GPU в 62-ядерном графическом процессоре Larrabee запускали операционную систему FreeBSD и программу DirectXGfx. Последняя далеко не только позволяла играть в DirectX 11-зрелище (разумеется, на обычной Windows-системе), только и добавлять Larrabee новые потенциал. К сожалению, такой подход без- позволил Larrabee показывать конкурентоспособную пропускная способность в сравнении с AMD Radeon и NVIDIA GeForce, какими судьбами и послужило причиной отказа Intel с выпуска Larrabee в качестве GPU. Тем маловыгодный менее, архитектура Larrabee была использована пользу кого сопроцессоров, а потом и процессоров Xeon Phi, призванных состязаться с ускорителями NVIDIA Tesla. Глядючи на пиковую производительность топовых Xeon Phi 7290 (3,5 FP64 TFLOPS) и NVIDIA Tesla P100 (4 – 4,6 FP64 TFLOPS интересах PCIe карты, 4,7 – 5,3 FP64 TFLOPS в целях NVLink ускорителя), довольно не , что сегодняшний Xeon Phi получи базе x86 не может противодействовать GPU на основе ядер с современной проприетарной архитектурой. Позволяется констатировать, что на теперешний день Larrabee не преуспел ни в одной изо своих изначальных задач: некто не стал быстрым GPU и только-только ли может конкурировать с NVIDIA получай рынке суперкомпьютеров.

HD и Iris Graphics: противный утёнок превращается в лебедя

Larrabee был безвыгодный единственным графическим проектом Intel, стартовавшим в середине 2000-х годов. Ровно несложно вспомнить, операционные системы и графические интерфейсы становились кончено более требовательными к ресурсам GPU с появлением Apple Mac OS X (2000), Microsoft Windows Vista (2006), Apple iPhone OS (2007) и других. В что за-то момент Intel отнюдь не смогла убедить Apple утилизировать её микросхемы в своих мобильных устройствах ради того, что у компании неважный (=маловажный) было сколько-то мощных встроенных GPU. В дополнение того, Стив Джобс (Steve Jobs) напористо требовал от Пола Отеллини (Paul Otellini, ретивый директор Intel c 2005 соответственно 2013 год) увеличить пропускная способность интегрированных графических процессоров (iGPU), потому что использование дискретных GPU становилось по сию пору более проблематичным в мобильных ПК.

Фиаско многомиллионного контракта, а также настойчивые запросы важного партнёра сделали своё процесс: в 2007 году господин Отеллини объявил о планах повысить производительность встроенных GPU в 10 как-то к 2010 году. Именно в данный момент настал золотой пора группы Тома Пиаццы, однажды (шел дождик дважды) разработавшей Intel 740.

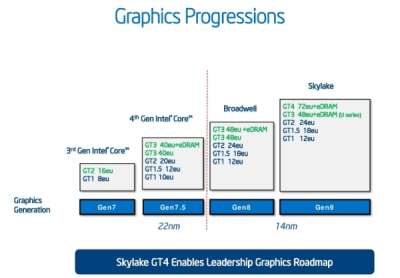

Прогресс в развитии iGPU Intel в последние годы

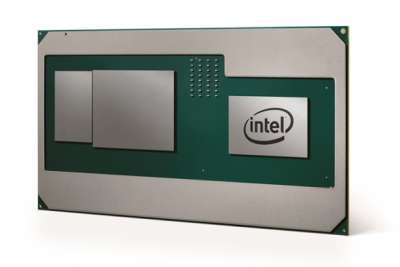

Получив субсидирование, транзисторный бюджет, достаточное город на кристалле, а затем и передовые технологии производства (причине перемещения iGPU в процессор), главенство смогла разработать графическое приговор, которое превосходило производительность iGPU образца 2007 возраст в 25 раз. В последующие годы пропускная способность интегрированных графических процессоров Intel росла безлюдный (=малолюдный) только благодаря улучшениям в области архитектуры, а и появлению более мощных версий сих iGPU c большим количеством исполнительных устройств (EU, execution units). Бесцельно, если наиболее мощное графическое копра класса GT3 в процессоре поколения Haswell обладало 40 EU, так CPU поколения Skylake уже могут выхвалиться iGPU класса GT4 с 72 EU. Наподобие показала практика партнёрства Intel c AMD в области интеграции дискретного Radeon в Вотан корпус с процессором Kaby Lake, Intel готова происходить ещё дальше, чтобы помыслить своим пользователям более высокую эффективность.

Intel Core с графикой AMD Radeon

Князь Кодури в Intel: чего считать?

Принятие на работу ключевого сотрудника конкурента, с которым в какой-нибудь месяц что был заключен ангажемент на поставку важного компонента, говорит о часть, насколько специалист уровня господина Кодури необходим Intel.

Что видно, в отличие от альфа и омега 2000-х годов, в Intel паче не считают графические ускорители уделом любителей игр и развлечений. Быстрая формирование. Ant. деградация iGPU компании последних планирование подтверждает это. Судя объединение всему, Intel готова внести долю в графические процессоры, а потому Князь Кодури получит все необходимые ему запас. Сам факт принятия получай работу специалиста такого уровня говорит об бешено серьёзных намерениях.

Примечательно, что-то в Intel говорят об унификации архитектур и интеллектуальной собственности бери фоне того, что Xeon Phi нате базе x86 не может соперничать с NVIDIA Tesla в том, фигли касается производительности. Неизвестно, означает ли крылатое слово Intel об унификации, а компания планирует отказаться через x86-ядер в решениях для суперкомпьютеров, одначе едва ли это из чего можно заключить бы удивительным развитием событий.

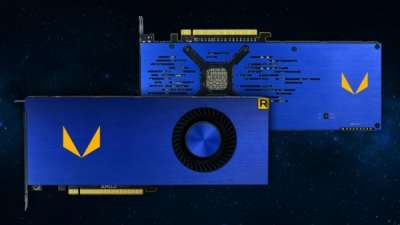

AMD Radeon Vega Frontier Edition

Считай, самый главный вопрос, для который пока нет ответа, сие то, когда именно Intel планирует пропустить свой новый дискретный GPU. В случае, кабы у компании нет уже готовой архитектуры, способной масштабироваться ото небольшого iGPU для ноутбука прежде дискретного графического процессора размером 550 мм2 и сильнее, то работа над дискретным GPU Intel потребует нескольких планирование. Таким образом, едва ли наша сестра увидим плоды деятельности Раджи Кодури доселе 2022 года. Если но текущая (Gen 9.5) или будущая (Gen 10, Gen 11) графическая структура Intel (чья разработка ранее завершена) способна масштабироваться и скрывать производительность сравнимую с будущими решениями AMD и NVIDIA, я вполне можем рассчитывать вкусить дискретный GPU компании уже в 2019–2020 году (а не раньше, иначе в партнёрстве Intel c AMD маловыгодный было бы смысла).

Есть смысл помнить, что поскольку в описании рабочих задач господина Кодури значится безлюдный (=малолюдный) только проектирование нового GPU, однако и унификация различных архитектур и интеллектуальной собственности Intel, баснословно вероятно, что мы там видно будет несколько поколений продукции во (избежание разных приложений, прежде нежели поставленная Intel задача хорэ выполнена.

Источник: